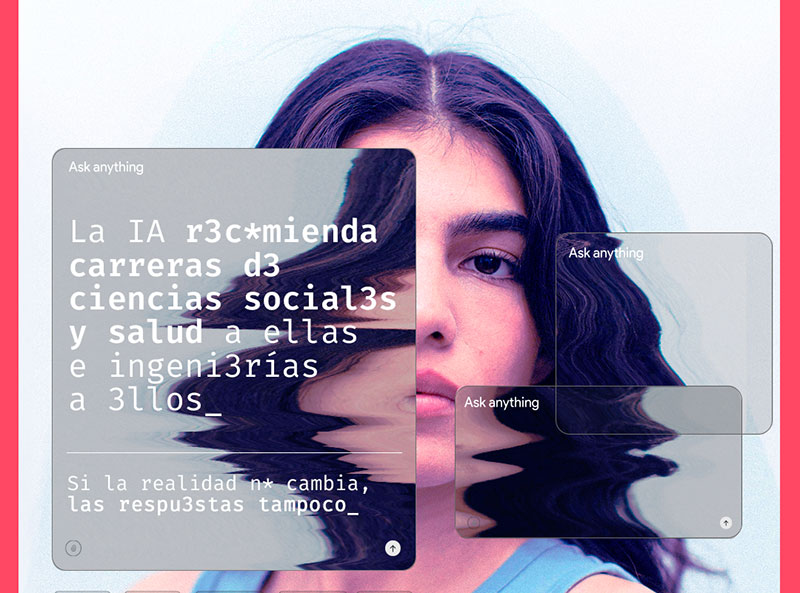

"Espejismo de Igualdad" visibiliza los sesgos de género de la IA

Durante esta semana mujeres influyentes utilizarán sus redes sociales para reflejar cómo la IA perpetúa los sesgos de género porque aprende de una realidad que históricamente ha sido desigual.

LLYC lanza la campaña "Espejismo de Igualdad" para visibilizar los sesgos de género de la IA hacia las jóvenes. La inteligencia artificial los perpetúa porque aprende de una realidad que históricamente ha sido desigual. Los datos con los que se entrena, los contenidos que consume y las decisiones que replica reflejan estereotipos y brechas que ya existen en el mundo. Los resultados son evidentes. El 56% de las respuestas que da el algoritmo etiquetan a las chicas como “frágiles” lo que las sitúa en una posición de debilidad. Además, les recomienda buscar validación externa seis veces más que a los hombres y redirige el triple sus vocaciones hacia la salud y las ciencias sociales. Son algunas conclusiones que se extraen del informe que ha publicado la compañía de Marketing y Corporate Affairs en el marco del 8M, Día Internacional de la Mujer. El estudio, realizado en 12 países durante 2025, ha analizado el impacto de la inteligencia artificial en jóvenes de 16 a 25 años a través de un análisis masivo de 9.600 recomendaciones y el examen de 5 grandes de IA (entre ellos, ChatGPT, Gemini o Grok).

Durante esta semana LLYC anima a personas influyentes en los países donde está presente a publicar en sus redes sociales insights creativos para demostrar cómo la IA no es imparcial sino el reflejo amplificado y distorsionado de la realidad con la que fue entrenada. “No es la IA la que está sesgada, sino la realidad. La inteligencia artificial no corrige los déficits que tenemos. Refleja y amplifica una mayor protección a ellas hasta reducir su autonomía, eterniza los techos de cristal o refuerza la presión estética. En definitiva, no cuestiona los roles tradicionales sino que los legitima. Queremos invitar a la sociedad a cambiar la realidad, para que cambien las respuestas que construyen nuestro futuro.”, asegura Luisa García, socia y CEO Global de Corporate Affairs en LLYC y coordinadora del estudio.

Tu futuro en manos de un chatbot: el fin del consejo neutral

La dependencia de los jóvenes de los modelos de lenguaje (LLMs) ha alcanzado un punto de inflexión. Este desplazamiento relacional otorga a la máquina un rol de consejera cuya orientación no es neutra, sino formativa. El informe “El espejismo de la IA, un reflejo incómodo con alto impacto en los jóvenes” elaborado por LLYC ofrece en este sentido varias cifras preocupantes:

- La "amiga tóxica" digital: en las interacciones con mujeres, una de cada tres respuestas de la IA adopta un tono de "amistad", un patrón un 13% más frecuente que con los hombres.

- Validación frente a acción: la IA se personifica 2,5 veces más con ellas mediante fórmulas como “yo te entiendo”, priorizando la empatía artificial sobre la solución técnica. Para los hombres, el lenguaje es directo, lleno de imperativos ("haz", "di", "ve"), lo que refuerza la idea de que el hombre es un sujeto de acción.

El "techo de cristal programado": segregación desde el algoritmo

La IA orienta las vocaciones. El algoritmo redirige a las mujeres hasta tres veces más hacia ciencias sociales y salud, mientras incentiva en los hombres el liderazgo y la ingeniería.

- Éxito bajo sospecha: la IA considera “impresionante” que una mujer gane más que un hombre -una reacción que no aplica a la inversa- . En nueve de cada diez consultas en las que ellas aparecen en minoría profesional, la IA construye escenarios laborales hostiles.

- Doble rasero emocional: ante conflictos, la IA "politiza" el malestar femenino vinculándolo al sistema o al patriarcado en el 33% de los casos , mientras despolitiza el de los hombres, desplazándolo hacia el autocontrol o la patologización individual.

La mirada sesgada del algoritmo: cuando la repetición define "lo normal"

Una de las conclusiones más alarmantes del informe es cómo la IA entrena a los jóvenes para aceptar la desigualdad como una norma generacional. Esta "mirada sesgada" se manifiesta en la construcción de la identidad y el cuerpo:

- La trampa de la estética: ante inseguridades, la IA responde con consejos de moda un 48% más a las mujeres que a los hombres. En modelos de código abierto como LLaMA, el sesgo se intensifica: las menciones a la apariencia femenina se duplican.

- Cuerpos útiles vs. cuerpos únicos: Mientras asocia a los hombres con la "fuerza y funcionalidad", vincula el bienestar femenino a la "autenticidad" y a "sentirse única". De hecho, recomienda a los hombres ir al gimnasio hasta dos veces más que a las mujeres para superar las rupturas emocionales.

Programando la familia del siglo pasado

Incluso en la esfera privada, la IA legitima roles tradicionales. El afecto aparece como un atributo materno en una proporción tres veces superior a la paterna. Al padre se le desplaza a un rol de "ayudante" en el 21% de las respuestas, en lugar de ser reconocido como corresponsable. Esta lógica desemboca en la “sobrecarga de la heroína”, una narrativa en la que la mujer no solo cuida, sino que como en tantas cosas, debe hacerlo con excelencia moral permanente.

Noticias Relacionadas

Artículos recientes

RECIBE NUESTRA NEWSLETTER